你有没有听过人们谈论喜剧、音乐、舞台或银幕上的新星,形容他们是“一夜成名”?如果你仔细研究一下,你会经常发现,这种“一夜成名”是经过十年甚至更久的艰苦工作才获得的。

这让我想起了我曾经看过的一部动画片,讲的是“只有贵族才能买得起的‘农民look’”,但我要尽量不误入歧途……

说了这么多,我想说的另一件事是,在我看来,我经常听不到任何新的技术创新,直到突然之间,所谓的创新开始到处出现。例如,就在几周前,我还在胡扯什么是革命性的新模拟技术,用于执行当今人工智能(AL)、机器学习(ML)和深度学习(DL)算法的核心矩阵乘法(见来看看神话AI即将成为传奇的模拟AI).

我刚和马克·雷滕聊了聊,他是硅存储技术(SST),它本身就是微芯片技术.你可以想象,当我发现SST的SuperFlash memBrain技术时,我是多么的惊讶和喜悦最低音的萨克斯,自2015年以来一直在开发中,当你想到这些天的事情发展得有多快时,这几乎是黑暗时代。

SuperFlash memBrain是一种神经形态多层次非易失性存储器(NVM)解决方案,使用SST的标准SuperFlash存储单元为AI、ML和DL应用提供内存计算架构,该存储单元已经在许多半导体代工厂中投入生产。

我们用"神经形态"这个词是什么意思?根据维基百科的说法:神经工程神经形态计算,也被称为神经形态计算,是使用包含电子模拟电路的超大规模集成(VLSI)系统来模拟神经系统中存在的神经生物架构。神经形态计算机/芯片是任何使用物理人工神经元(由硅制成)来执行计算的设备。”

为了设定场景,让我们提醒自己,我们的大脑是由一种叫做神经元的细胞形成的,神经元通过突触相互交流。让我们也提醒自己,一个典型的闪存单元是基于浮栅晶体管,它可以用来表示数字0或1值。相比之下,一个SuperFlash memBrain存储单元可以用来表示256个不同的值,从而允许每个单元表示人工神经网络(ANN)中与“突触”相关的“权重”(系数)。

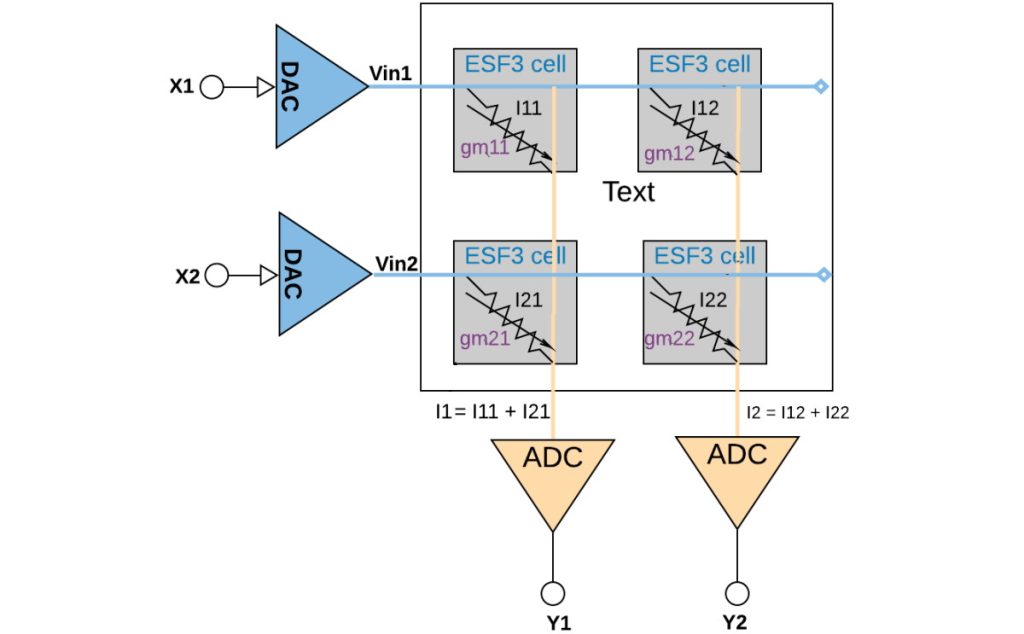

这里需要记住的重要一点是,AI / ML / DL应用程序使用了大量的矩阵乘法运算,这些运算本身使用了乘法-累积(MAC)运算。考虑一个非常简单的例子,它只包含四个这样的单元格,表示为2×2数组。

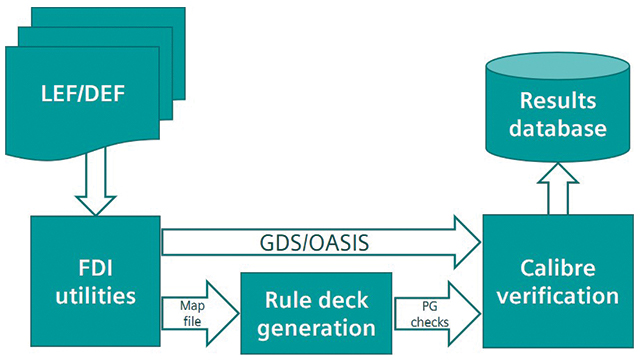

使用memBrain进行简单的MAC操作(图片来源:SST)

我们可以把SuperFlash memBrain记忆单元看作是一个可编程电阻。根据欧姆定律,我们知道V = IR,所以I(流经电池的电流)= V/R。电阻(R)的倒数是电导(G);即G = 1/R。这意味着I = V * G(我们的乘法)。此外,来自同一列中每个单元格的电流是相加的(我们的累积)。因此,以同样的方式,这些细胞中的每一个都可以被认为执行突触的功能,每一列都可以被认为执行神经元的功能。

层次结构的下一步是memBrain tile,它是前面提到的单元格的一个大数组,并对输入和输出进行适当的信号调节。

认识一个memBrain贴图(图片来源:SST)

与标准数字嵌入式闪存相比,这个阵列的输入和输出非常宽。因此,权重首先存储在memBrain阵列中,作为浮动门上的电导值。SuperFlash memBrain细胞既可以存储权重,也可以在输入电压刺激下进行乘法运算,产生的电流是可加的,可以同时进行数百万次MAC运算。这里需要注意的关键是,每个硅区域的性能和功耗比优化的数字解决方案好几个数量级。

这个SST实现如此令人兴奋的原因是片上系统(SoC)设备的创造者可以在他们的设计中使用SuperFlash memBrain (IP)。例如,根据Microchip今年早些时候发布的新闻稿,一家公司打电话给WITINMEM已经将他们自己定制的SuperFlash memBrain技术集成到超低功耗SoC中,充分利用这种内存计算技术进行人工神经网络处理,包括语音识别、声纹识别、深度语音降噪、场景检测和健康状态监控。

更新:Silicon Storage Technology (SST)授权部门的副总裁Mark Reiten就客户WITINMEM提供了一些澄清:“WITINMEM从SST购买了设计许可,并根据他们的架构设计了他们自己的内存计算块,这与我们的memBrain设计软件类似,但有许多他们自己的创新。SST提供了嵌入式Flash单元和表征数据,但设计软件、系统架构和相关的机器学习软件工具由WITINMEM创建。WITINMEM是全球第一家使用这种高可靠和稳定的音频处理技术部署内存计算产品的公司,我们很高兴有这样一个成熟的客户和团队基于这种新的和令人兴奋的计算范例开发突破性的产品。”

我从门阵列专用集成电路的日子。那时,我们梦想拥有比AND门或d型触发器更复杂的东西来工作。我所能说的是,将这种模拟矩阵乘法IP用于AL / ML / DL应用程序的能力会让我们摇头怀疑。

我将包括我在下面提到的新闻稿。我要提醒大家的是,我欢迎大家的评论和提问,我也期待听到大家对这一切的看法。

内存计算创新者使用Microchip的模拟嵌入式SuperFlash®技术解决边缘语音处理挑战

SuperFlash memBrain™内存解决方案使WITINMEN的片上系统(SoC)能够满足最苛刻的神经处理成本、功耗和性能要求。

位于亚利桑那州钱德勒市的。2022年2月28日消息——内存计算技术有望消除与在网络边缘执行人工智能(AI)语音处理相关的大规模数据通信瓶颈,但需要一种同时执行神经网络计算和存储权重的嵌入式内存解决方案。Microchip Technology Inc. (Nasdaq: MCHP)通过其硅存储技术(SST)子公司今天宣布,其SuperFlash memBrain神经形态存储解决方案已经解决了WITINMEM神经处理SoC的这一问题,这是第一个量产的子系统,能够在通电后实时和立即降低语音噪声并识别数百个命令字。

Microchip与WITINMEM合作,将Microchip基于SuperFlash技术的memBrain模拟内存计算解决方案整合到WITINMEM的超低功耗SoC中。该SoC具有用于神经网络处理的内存计算技术,包括语音识别、声纹识别、深度语音降噪、场景检测和健康状态监控。反过来,WITINMEM正在与多个客户合作,在2022年将基于该SoC的产品推向市场。

WITINMEM首席执行官王少迪表示:“通过Microchip的memBrain解决方案,WITINMEM正在开辟新的领域,以解决基于先进神经网络模型的网络边缘实时AI语音的计算密集型需求。”“我们在2019年率先开发了用于音频的内存计算芯片,现在我们在超低功耗神经处理SoC中实现了该技术的量产,从而实现了另一个里程碑,简化并提高了智能语音和健康产品中的语音处理性能。”

SST许可证部门副总裁Mark Reiten表示:“我们很高兴WITINMEM成为我们的主要客户,并为该公司使用我们的技术,以卓越的产品进入不断扩大的AI边缘处理市场而欢呼。”“WITINMEM SoC展示了使用memBrain技术创建基于内存计算神经处理器的单芯片解决方案的价值,消除了使用数字DSP和基于SRAM/ dram的方法存储和执行机器学习模型的传统处理器的问题。”

Microchip的memBrain神经形态记忆产品经过优化,可用于神经网络执行向量矩阵乘法(VMM)。它使用于电池供电和深度嵌入边缘设备的处理器能够提供每瓦最高的AI推理性能。这是通过将神经模型权重存储为内存数组中的值,并使用内存数组作为神经计算元素来实现的。其结果是,与其他方法相比,功耗降低了10到20倍,同时由于不需要外部DRAM和NOR,整体处理器物料清单(BOM)成本也更低。

在memBrain解决方案的处理元素中永久存储神经模型还支持实时神经网络处理的即时启动功能。WITINMEM利用SuperFlash技术的浮栅单元的非易失性,在空闲状态下关闭内存计算宏,以进一步降低要求高的物联网用例中的泄漏功率。